Blog

A partir de imagens em vídeo, sistema detecta problemas de locomoção em suínos

Computador faz análise automática da claudicação em suínos, permitindo intervenções rápidas que garantam o bem-estar dos animais

Cenário desenvolvido no setor de suinocultura do campus da USP, em Pirassununga, com o objetivo de gravar a movimentação de suínos para avaliação e identificação de problemas de locomoção, como a claudicação, nos animais – Foto: Marisol Parada Sarmiento

Os problemas do aparelho locomotor representam um sério desafio para o bem-estar dos suínos de criação, com ocorrência em até 65% dos animais. Entre os distúrbios, a claudicação é uma mudança comportamental na locomoção, frequentemente associada a processos que causam dor. Pesquisadores da USP, em Pirassununga, desenvolveram um sistema computacional para avaliar de forma automática a claudicação em suínos a partir da gravação de imagens em vídeo, permitindo intervenções rápidas que melhorem as condições dos animais.

O trabalho é descrito em artigo na Scientific Reports, do grupo Nature, em 16 de julho. “Nos suínos mantidos em sistemas comerciais de produção, foram relatadas situações preocupantes”, afirma o professor Adroaldo Zanella, da Faculdade de Medicina Veterinária e Zootecnia (FMVZ) da USP, em Pirassununga, que supervisionou a pesquisa. “Nós demonstramos em trabalhos anteriores que a prole de fêmeas suínas que claudicam têm menor peso ao nascer e maior probabilidade de se envolver em comportamentos agressivos quando comparadas com a prole de fêmeas que não claudicam, além de apresentarem indicadores de medo e estresse alterados”.

“A detecção de claudicação é efetuada através de escalas visuais que levam em consideração a postura e padrões de locomoção dos animais”, aponta o professor da FMVZ. “Os protocolos existentes de avaliação de claudicação demandam tempo, são subjetivos e apresentam bastante variabilidade nos resultados de identificação de problemas de movimentação, especialmente nas fases iniciais do processo”.

De acordo com Zanella, com base nas escalas já validadas, avaliadores treinados podem identificar animais claudicando em fases iniciais, o que é importante para a rápida intervenção terapêutica. “O problema é que a avaliação demanda tempo, treinamento dos avaliadores, e apresenta um grau de subjetividade que pode comprometer os resultados”, enfatiza. “Nós identificamos uma variabilidade significativa entre avaliadores, mesmo treinados, ao analisarem os estágios iniciais da claudicação.”

Os pesquisadores desenvolveram um cenário controlado para coleta de vídeos nas instalações de produção de suínos do campus da USP, em Pirassununga, e na Granja de Genética Suína Topgen, em Jaguariaíva, no estado do Paraná. “Com apoio de 13 especialistas em imagens, foram avaliados 364 vídeos de fêmeas suínas em locomoção na visão lateral, e 336 vídeos na vista dorsal”, relata a zootecnista Tauana Maria Carlos Guimarães de Paula, que elaborou o sistema durante estudo de mestrado na FMVZ. “Os dados foram compilados com foco onde houve consenso entre os avaliadores. Todos os vídeos estão disponíveis no site Animal Science Hub, e os 106 melhores foram usados no desenvolvimento dos modelos computacionais.”

Cenário para gravação de movimentos com o notebook (1), que recebe as imagens das câmeras (2 e 3), captadas no corredor por onde os animais andavam (4), iluminado por refletores (5), e mais um notebook está acoplado à câmera que faz imagens do alto (6) – Foto: Tauana Maria Carlos Guimarães de Paula

Pontos-chave

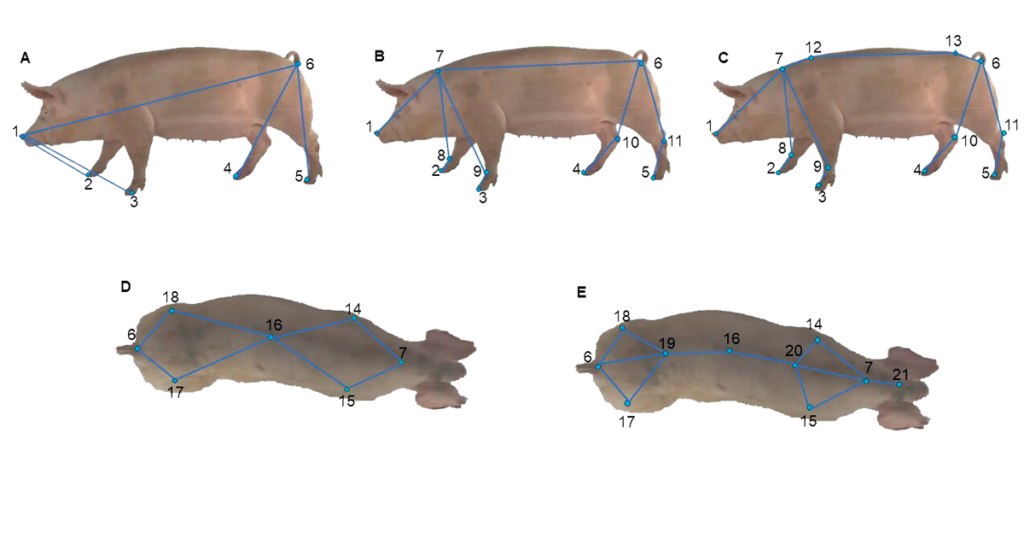

Tauana Maria observa que para a elaboração do modelo foram identificadas as áreas importantes (pontos-chave) do corpo das fêmeas suínas, como patas, focinho e cauda, entre outras. “Posteriormente, esses dados serviram para indicar padrões de movimentação específicos de cada condição de claudicação”, descreve. “Com base nos pontos-chave, foram criados esqueletos virtuais, que são um registro da pose de animais diferentes para observação, três na vista lateral, com seis, 11 e 13 pontos-chave, e dois para a vista dorsal, com sete e dez pontos-chave”.

O banco de imagens com anotação do esqueleto foi usado para treinamento de modelo computacional baseado em técnica de aprendizado profundo de máquina e em um novo método de processamento proposto pelo grupo.

Identificação de pontos-chave nas vistas lateral e dorsal das porcas, formando um esqueleto virtual que permite, por meio de aprendizado de máquina, obter um modelo computacional que identifica padrões de claudicação no movimento dos animais – Imagem: cedida pelos pesquisadores

O Professor Rafael Vieira de Sousa, da Faculdade de Zootecnia e Engenharia de Alimentos (FZEA) da USP, co-orientador do mestrado, destaca que o novo método é composto pela integração de duas técnicas. “A primeira gera um modelo computacional por aprendizado profundo que realiza a identificação e rastreamento dos pontos-chave do esqueleto virtual ao longo de um vídeo”, relata. “A segunda usa dados gerados por análise cinemática aplicada ao esqueleto virtual para alimentar um classificador baseado em aprendizado de máquina que identifica presença de padrões de claudicação.”

“Os resultados foram promissores para o desenvolvimento de modelos que identificam a claudicação em suínos através da pose e do rastreamento dos pontos-chave no corpo do animal”, destaca Tauana Maria. “Na vista lateral, o modelo com seis pontos-chave obteve melhor desempenho, e na dorsal, o modelo com dez pontos-chaves conseguiu elevada performance”.

Segundo o professor Zanella, os modelos têm o potencial para compor uma plataforma de visão computacional para identificar automaticamente poses de locomoção em fêmeas suínas. “Eles podem ser utilizados como uma ferramenta e um método de precisão que ajuda a identificar de forma objetiva o comportamento de locomoção das fêmeas suínas a fim de detectar a claudicação em fases iniciais, para promover intervenções rápidas e melhorar o bem-estar animal”, salienta.

Também fizeram parte da pesquisa a pós-doutoranda Marisol Parada Sarmiento, que trabalhou no desenvolvimento do projeto e coordenou a coleta dos vídeos, auxiliada pelo pós-doutorando Leandro Sabei e a veterinária Júlia Silvestrini. O professor Rafael Vieira de Sousa e o tecnólogo Edson Sardinha do Laboratório de Robótica e Automação para Engenharia de Biossistemas FZEA-USP, em Pirassununga, apoiaram o desenvolvimento do sistema computacional, enquanto o pesquisador Ton Kramer facilitou o engajamento de profissionais para analisar os vídeos com protocolos validados de avaliação. A graduanda de veterinária da FMVZ USP, Mirela Vilioti, colaborou na rotulagem dos vídeos para as análises; a proprietária da granja Topgen, Beate Von Staa, disponibilizou as instalações da granja e as fêmeas suínas para realizar as filmagens; e a empresa Zinpro apoiou o projeto.

Mais informações: email adroaldo.zanella@usp.br, com o professor Adroaldo Zanella

LEIA +

A reprodução de matérias e fotografias é livre mediante a citação do Jornal da USP e do autor. No caso dos arquivos de áudio, deverão constar dos créditos a Rádio USP e, em sendo explicitados, os autores. Para uso de arquivos de vídeo, esses créditos deverão mencionar a TV USP e, caso estejam explicitados, os autores. Fotos devem ser creditadas como USP Imagens e o nome do fotógrafo.